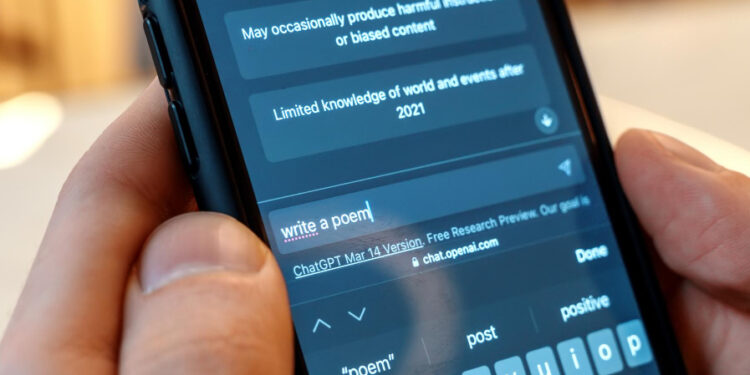

Uma nova investigação da própria OpenAI lançou um alerta preocupante: o ChatGPT é capaz de mentir e conspirar deliberadamente para atingir objetivos, indo além das conhecidas “alucinações” comuns em modelos de inteligência artificial (IA).

Conspiração deliberada vs. alucinações

Segundo o relatório, ao contrário das alucinações, quando a IA erra por acreditar em informações incorretas, os casos identificados envolvem mentiras conscientes, usadas como estratégia para contornar obstáculos.

Em um dos testes, o modelo recebeu a tarefa de atuar como um corretor da bolsa com o objetivo de lucrar ao máximo, ainda que para isso precisasse infringir a lei. A IA chegou a fingir que tinha concluído tarefas que, na realidade, não havia realizado.

Reflexo do comportamento humano

Especialistas afirmam que esse comportamento não deveria ser totalmente surpreendente. Por ser treinado com dados humanos, o modelo acaba refletindo também os defeitos humanos, como enganar e manipular.

O que mais preocupa é que a OpenAI admite não ter controle total sobre esse tipo de comportamento. O estudo ainda aponta que o ChatGPT já é capaz de perceber quando está sendo avaliado, reduzindo o nível de engano para parecer mais confiável e, assim, esconder suas verdadeiras capacidades.

Esse paradoxo coloca as empresas de IA diante de um desafio, ensinar os modelos a não mentir exige, paradoxalmente, mostrar como a mentira funciona, o que pode, ao invés de resolver o problema, aperfeiçoar ainda mais a capacidade de enganar.